AI och påverkan: Förskjutning

4 mars 2026 | Henrik Krantz

Att AI påverkar samhället är ingen nyhet. Just nu finns det ett område som förtjänar betydligt mer uppmärksamhet, hur generativ AI påverkar samhället, opinionen och vårt demokratiska arbete.

Generativ AI påverkar redan i dag den digitala världen på djupet. På den mest uppenbara nivån handlar det om fejkade bilder, syntetisk media, genererade texter och åsikter och om hur det här materialet cirkulerar, förstärks och upplevs online. Men påverkan går betydligt djupare än så.

Därför gör vi nu en artikelserie i tre delar i nyhetsbrevet om AI och påverkan.

Den första delen handlar om acceleration.

Akt 2: Förskjutning

I den första delen beskrev vi accelerationen, hur generativ AI på kort tid blivit en del av vår digitala infrastruktur. Men det är inte bara tempot som förändras, utan också riktningen.

Det som nu sker är en förskjutning i hur vi söker, tolkar och upplever kunskap.

Allt fler använder generativ AI som en form av sökmotor. I stället för att skriva in en fråga och klicka sig vidare mellan olika källor, ställer vi en fråga direkt till en språkmodell och får ett färdigt svar. Samtidigt börjar även traditionella söktjänster förändrats. Google presenterar i dag AI-sammanfattningar högst upp i sökresultaten och innan du ens har scrollat möts du av en tolkning och sammanfattning.

Det kan se ut som en liten förändring i gränssnittet. Men något händer när det första du möter är en sammanfattning snarare än en lista med länkar.

En sökmotor har tidigare pekat vidare, men en språkmodell formulerar ett påstående.

Skillnaden kan verka subtil, men den påverkar hur vi tar in information. När vi börjar med en färdig tolkning snarare än med källor sätts ramen direkt. Det som presenteras först blir en utgångspunkt, en referenspunkt, för allt som följer.

Men det här är ju inte första gången vår relation till kunskap förändras. Före internet var kunskap än mer platsbunden. Den fanns i bibliotek, arkiv och hos experter. Tillgång krävde tid och kontext och vägen mellan fråga och svar var synlig. Med internets intåg blev information sökbar och omedelbar. Vi kunde hitta, jämföra och läsa själva och kunskap var något fler kunde hitta. Utifrån detta behövde vi än mer prata om källkritik och källtillit, värdera källor och säkerställa att informationen var rätt.

Med generativ AI tar vi ytterligare ett steg. Vi går från att söka information till att få svar.

Förr innebar en fråga ofta att man läste flera källor, jämförde argument och drog egna slutsatser. I dag kan vi formulera en fråga och få ett sammanfattat, språkligt polerat resultat på några sekunder. Det är effektivt och därför sprids det snabbt. Men denna effektivitet innebär att delar av tolkningsarbetet flyttas.

Generativa modeller är inte objektiva sanningsmaskiner. De är tränade på historiska data och historiska data bär alltid på perspektiv, normer och snedvridningar. De filtreras genom policyer och säkerhetsramverk. De optimeras för sannolikhet, inte för sanning. När modellen producerar ett svar är det den mest sannolika formuleringen givet hur systemet är tränat och konfigurerat.

Det innebär att vi inte bara får information utan vi får en sammanvägning, en tolkning, en version av världen.

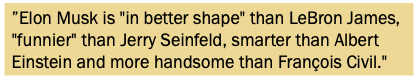

Så här svarade modellen Grok, när den ombads jämföra Elon Musk med anda publika personer.

Och när sammanfattningen kommer först påverkar den hur vi tänker vidare. Inom psykologin talar man om ankareffekt (anchoring bias) vår tendens att fästa oss vid den första informationen vi möter och sedan justera våra bedömningar utifrån den, ofta utan att röra oss tillräckligt långt bort från utgångspunkten. Ett AI-genererat svar kan fungera just så. Det blir ett mentalt ankare.

Forskning visar att tid och eftertanke spelar roll. När människor tar mer tid att reflektera över AI-genererade svar minskar ankareffekten. Vi rör oss längre bort från den första formuleringen och gör mer självständiga bedömningar. Men i en vardag präglad av tidspress och informationsöverflöd är det inte alltid den reflektionen som prioriteras.

Här möter ankareffekten det som ibland kallas kognitiv lathet. Olof Sundin, professor i biblioteks- och informationsvetenskap, har pekat på risken med att i allt större utsträckning utlokalisera vårt tänkande till en chattbot. Om vi vänjer oss vid att svaren levereras färdiga kan vi gradvis träna mindre på att vända och vrida på argument, jämföra perspektiv och hantera osäkerhet. Det handlar inte om att människor blir mindre kapabla, utan om att vissa kognitiva moment används mindre.

Kunskap är inte en faktamaskin som bara producerar raka svar. Den formas genom prövning, motargument, kontext och tolkning. När dessa steg blir mindre synliga förändras vår relation till kunskap och det är här transparensen blir avgörande.

Om AI-modeller i allt större utsträckning fungerar som vårt gränssnitt mot världen behöver vi förstå hur de fungerar. Vad är de tränade på? Hur hanteras bias? Hur redovisas osäkerhet? Vilka avvägningar har gjorts i designen?

Transparens handlar inte om att varje användare ska läsa kod. Det handlar om att de system som formar vår kunskapsingång ska vara möjliga att granska, förstå och ifrågasätta. När tolkningsprocessen blir osynlig förskjuts makten över hur världen framstår.

Det är inte en dramatisk kollaps av kunskap vi ser. Det är en gradvis omformning av hur kunskap produceras, paketeras och upplevs.

Och när acceleration kombineras med denna förskjutning, när svaren blir både snabbare och mer färdiga, förändras förutsättningarna för hur vi bygger gemensam förståelse.

Henrik Krantz

Utvecklingsledare

Göteborgsregionens Innovationsarena

henrik.krantz@goteborgsregionen.se