Omvärldskollen v18

29 april 2026 | Henrik Krantz

Det händer mycket inom AI-området. I vår omvärldsbevakning spanar vi på de frågor som är extra relevanta för Innovationsarenans arbete. Varje vecka sammanfattar vi ett axplock av de viktigaste AI-nyheterna.

Vi håller koll åt dig, helt enkelt.

Mythos

Anthropic har ju som ni säkert läst beslutat att inte släppa sin nya AI-modell Claude Mythos publikt, eftersom bolaget bedömer att den kan innebära allvarliga risker för global cybersäkerhet. Modellen sägs kunna hitta och i vissa fall utnyttja tidigare okända sårbarheter, så kallade zero-days, i viktiga operativsystem och webbläsare. Samtidigt utreder Anthropic uppgifter om att en mindre grupp användare i ett privat forum ska ha fått obehörig tillgång till modellen.

Mythos har granskats av Storbritanniens AI Security Institute, som beskriver den som ett tydligt steg framåt jämfört med tidigare modeller, bland annat eftersom den kan genomföra mer komplexa cyberangrepp i flera steg. Anthropic har gett ett 40-tal företag, däribland banker och techbolag, tidig tillgång genom Project Glasswing för att testa modellen i försvarssyfte.

Flera experter varnar för riskerna om tekniken hamnar i fel händer, särskilt för finanssektorn. Andra menar att hotbilden behöver nyanseras och att många cyberintrång fortfarande beror på äldre, välkända brister som inte har åtgärdats. Oavsett är det något vi alla bör ta på allvar, då utvecklingen går i rasande takt.

Vill ni höra mer om Mythos så publicerade AI Sweden nyligen ett webinarium som förklarar mer:

OpenAI vill ta ansvar

OpenAI beskriver AI som en teknik med potential att ge människor betydligt större möjligheter, ökad självständighet och ett mer meningsfullt liv. Bolaget betonar samtidigt att utvecklingen inte automatiskt leder dit. Framtidens makt över superintelligens kan antingen koncentreras till ett fåtal företag eller spridas brett till människor, och OpenAI säger sig vilja verka för det senare.

Arbetet styrs enligt texten av fem principer: demokratisering, stärkt egenmakt, universellt välstånd, motståndskraft och anpassningsförmåga. Det handlar både om att ge många tillgång till kraftfull AI och om att viktiga beslut ska fattas genom demokratiska processer. Samtidigt framhålls behovet av försiktighet, särskilt när tekniken kan skapa nya risker inom exempelvis cybersäkerhet och biologiska hot. Samtidigt betonas också att framtiden är svår att förutse och att bolaget behöver kunna ompröva sina principer när mer kunskap finns. Utvecklingen ska ske stegvis, i samspel med samhälle, regeringar och andra aktörer, med målet att maximera nyttan och minska riskerna.

Och släpper ny modell

OpenAI har nu lanserat GPT-5.5, som bolaget beskriver som sin hittills smartaste och mest intuitiva AI-modell. Enligt medgrundaren Greg Brockman innebär modellen ett steg mot mer agentbaserad och lättanvänd datoranvändning, och för OpenAI närmare målet att bygga en bred ”superapp” som samlar tjänster som ChatGPT, Codex och en AI-webbläsare. GPT-5.5 sägs vara snabbare och mer effektiv än tidigare modeller och ska prestera bättre inom bland annat kodning, kunskapsarbete, matematik och vetenskaplig forskning. OpenAI säger också att modellen överträffar både egna tidigare modeller och konkurrenter från Google och Anthropic i flera jämförelsetester.

Från GPT:er till agentytor

Även agenter för arbetsytor har nu lanserats, en vidareutveckling av GPT:er som ska hjälpa team att hantera mer komplexa och långvariga arbetsflöden. Agenterna körs i molnet, kan delas inom organisationer och används i ChatGPT eller Slack för uppgifter som att sammanställa rapporter, skriva kod, besvara meddelanden, skapa ärenden och följa upp kundkontakter.

Tanken är att agenterna ska kunna arbeta med gemensam kontext, hämta information från rätt system, följa interna processer och be om godkännande när det krävs. OpenAI lyfter exempel från bland annat försäljning, redovisning, produktfeedback, mjukvarugranskning och leverantörsrisker, där agenter kan automatisera återkommande moment och göra teamens arbetssätt mer enhetliga.

Organisationer behåller kontrollen genom att styra vilka data, verktyg och åtgärder agenterna får använda och administratörer får också insyn i konfigurationer, körningar och användning.

Meta säger upp mer personal?

Mark Zuckerberg har tidigare sagt att 2026 blir året då AI på allvar förändrar hur människor arbetar, och att enskilda medarbetare med AI-stöd nu kan utföra arbete som tidigare krävde större team. Meta har redan genomfört mindre uppsägningsrundor i år, men de kommande nedskärningarna blir bolagets största sedan 2023.

För nu planerar bolaget att säga upp omkring 10 procent av personalen, motsvarande cirka 8 000 anställda, samtidigt som bolaget kraftigt ökar sina investeringar i AI. Enligt ett internt memo ska företaget även låta bli att tillsätta tusentals öppna tjänster. Meta uppges i år lägga 135 miljarder dollar på AI, ungefär lika mycket som under de tre föregående åren tillsammans.

Samtidigt för personalen som är kvar hos Meta så har bolaget tydligen utvecklat ett nytt övervakningsverktyg, Model Capability Initiative, som enligt Reuters ska kunna registrera anställdas musrörelser, klick och tangentbordstryckningar. Verktyget ska också med jämna mellanrum ta skärmdumpar av det som visas på medarbetarnas skärmar. Meta uppger att syftet främst är att samla in data för att träna AI-modeller i mänskligt beteende. Den förklaringen möter dock kritik. Yale-professorn Ifeoma Ajunwa menar att den här typen av verktyg i praktiken används för att övervaka anställda och kunna ingripa mot personer som anses missköta sig.

Mjukvara återskapas utan ursprunglig kod

Ett nytt AI-verktyg kallat Malus.sh uppges kunna skapa så kallade ”clean room”-kopior av mjukvara, där funktionaliteten återskapas utan att den ursprungliga koden används direkt. Verktyget framställs delvis som satir över konflikter i open source-världen, men drivs samtidigt som en verklig produkt med betalande kunder. Tekniken bygger på en äldre metod där ett team analyserar vad ett system gör, medan ett annat återskapar funktioner utan att se originalkoden. Med AI kan processen gå betydligt snabbare, eftersom kodgenererande modeller kan skriva ny kod som efterliknar ett programs funktioner men formellt skiljer sig från originalet. Malus.sh marknadsför detta som ett sätt att slippa krav på attribution och copyleft-licenser.

Artikeln kopplar verktyget till en bredare oro för att AI försvagar upphovsrättens praktiska skydd, även inom mjukvara. Ett färskt exempel är en AI-skapad omskrivning av Pythonbiblioteket chardet, som väckte debatt om kopior som inte erkänner eller krediterar ursprungliga utvecklare.

Pingisens schack-ögonblick?

Sonys AI-division har utvecklat den autonoma bordtennisroboten Ace, som enligt projektledaren är den första roboten att nå expertnivå i en fysisk tävlingssport. I Tokyo har Ace spelat mot elit- och proffsspelare enligt internationella bordtennisregler och har både vunnit och förlorat matcher mot mänskliga motståndare. Till skillnad från AI-system i digitala spel måste en bordtennisrobot hantera snabba beslut, fysisk precision, skruvade bollar och oförutsägbara motspelare i realtid. Ace använder nio synkroniserade kameror, flera visionssystem och en specialbyggd robotplattform med åtta leder för att läsa bollens rörelse och utföra slag med hög hastighet och noggrannhet.

Forskarna bakom projektet ser framstegen som relevanta även utanför sporten, exempelvis inom tillverkning, servicerobotik, underhållning och säkerhetskritiska miljöer där snabb fysisk interaktion krävs.

Städa, städa varje fredag..

AI-satsningar gör att företags gamla dataproblem blir svårare att bortse från. Enligt IDC riskerar cio:er som skjuter upp arbetet med dataskuld att få betydligt fler misslyckade AI-projekt och högre kostnader, eftersom modeller snabbt blottlägger brister som isolerade system, dubbletter, otydliga definitioner och data av låg kvalitet. Experter i artikeln beskriver dataskuld som ett resultat av åratal av tillfälliga lösningar, förvärv, gamla system och bristande styrning. I traditionell rapportering har problemen ofta kunnat hanteras manuellt, men AI är mindre förlåtande då fel och oklarheter förstärks när systemen automatiseras och skalas upp.

För att lyckas med AI behöver företag därför behandla data som en strategisk tillgång. Det kräver stöd från ledning och styrelse, tydligt ägarskap, standardiserade processer och löpande datastyrning. Samtidigt kan organisationer börja med avgränsade AI-tillämpningar där resultaten går att kontrollera, medan det större arbetet med att rensa, strukturera och säkra data fortsätter.

Tid för insatser i stället för sortering

Parks Victoria i Australien har utvecklat ett nytt AI-verktyg som snabbt kan analysera bilder från fältkameror och identifiera över 200 inhemska och invasiva arter med mer än 95 procents träffsäkerhet. Verktyget användes nyligen efter sommarens bränder i Otway Ranges, där 39 000 bilder från 73 kameror kunde gås igenom på bara några timmar. Det gjorde att hot från bland annat hjortar i brända områden kunde upptäckas och skickas vidare till ansvariga för djurkontroll. Systemet har tränats på fem miljoner bilder från 18 forsknings- och naturvårdsorganisationer i Victoria. Enligt Parks Victoria frigör tekniken tid och pengar, eftersom personalen slipper lägga veckor på att manuellt sortera bilder och i stället kan fokusera på naturvårdsinsatser.

Verktyget görs nu tillgängligt som öppen källkod och kan köras lokalt på användarens dator. Det gör att forskare och naturvårdare behåller kontrollen över känsliga data, vilket lyfts fram som särskilt viktigt för hotade arter.

Men sprid inte falska bilder på djur,

för en man i 40-årsåldern har gripits i Sydkorea efter att ha spridit en AI-genererad bild som påstods visa den förrymda vargen Neukgu vid en vägkorsning i Daejeon. Bilden fick myndigheterna att snabbt flytta sin sökinsats och skicka ut ett nödmeddelande till invånare om att en varg setts i området. Den användes även vid en pressbriefing, enligt lokala medier. Neukgu, en tvåårig varg som rymde från en djurpark den 8 april, fångades till slut nära en motorväg efter nio dagar på fri fot. Händelsen väckte stor uppmärksamhet i landet.

Polisen identifierade mannen efter att ha granskat övervakningsfilm och uppgifter om hans användning av AI-program. Det är inte klarlagt om han skickade bilden direkt till myndigheterna eller om han bara delade den online. Enligt lokala medier uppgav han i förhör att han gjort det ”för skojs skull”. Han utreds nu för att ha stört myndighetsarbete genom vilseledande uppgifter, ett brott som kan ge upp till fem års fängelse.

Fler studier om AI och hjärnaktivitet

En studie ledd av MIT-forskaren Nataliya Kosmyna pekar på att studenter som använde ChatGPT vid uppsatsskrivande visade lägre aktivitet i hjärnområden kopplade till kreativitet och informationsbearbetning. Studien, som ännu inte är peer review-granskad, följde 54 deltagare som skrev korta uppsatser under flera månader. De delades in i grupper som antingen använde ChatGPT, Google eller enbart sin egen kunskap. Forskarna såg att ChatGPT-gruppen presterade sämre på flera nivåer och blev mindre engagerad över tid. Deltagarna hade också svårare att återge innehåll ur sina egna texter, och uppsatserna blev så lika att en lärare undrade om studenterna satt bredvid varandra.

Artikeln kopplar resultaten till en bredare oro för att AI-verktyg kan göra det lättare att lämna över tänkandet till tekniken. Andra studier och användarberättelser pekar på liknande risker, där människor i hög grad väljer AI för resonemangsuppgifter och upplever att kreativitet, minne och förmågan att formulera nyanserade idéer påverkas.

Att designa för vanföreställningar

En ny studie, som ännu inte är granskad av andra forskare, pekar på att vissa ledande AI-chattbotar i högre grad än andra riskerar att bekräfta användares vanföreställningar. Forskarna bakom studien beskriver detta som ett förebyggbart design- och anpassningsproblem, snarare än en oundviklig följd av tekniken. I studien testades modeller från OpenAI, Google, xAI och Anthropic med en simulerad användare som gradvis utvecklade föreställningar om att världen var en datorsimulering. GPT-4o, Grok 4.1 och Gemini 3 bedömdes ha högre riskprofiler, men på olika sätt. GPT-4o beskrevs som särskilt bekräftande, medan Grok ibland byggde vidare på vanföreställningarna med egna detaljer. Gemini försökte i vissa fall minska skadan, men gjorde det inom användarens felaktiga verklighetsbild.

GPT-5.2 och Claude Opus 4.5 klarade sig bättre i testerna och svarade oftare med uppmaningar om mänsklig hjälp och medicinskt stöd. Forskarna menar att skillnaderna visar att säkrare beteenden går att bygga in och bör kunna bli branschstandard.

Frågan om vad AI-kompetens verkligen är fortsätter

Många har satsat på att göra personalen ”AI-redo”, men de första utbildningarna har ofta fokuserat för mycket på promptar och chattbotar. Enligt flera företagsledare är den verkliga utmaningen i stället att lära medarbetare att förstå arbetsflöden, granska resultat och veta när mänskligt omdöme måste väga tyngre än automatiserade rekommendationer.

Best Buys teknikchef Neal Sample beskriver AI-beredskap som något som handlar om ansvar, omformade processer och mätbara förbättringar, inte om antal utbildningar eller licenser. Liknande erfarenheter finns hos Cosnova Beauty, där fokus har flyttats från promptteknik till att kartlägga hur arbetet faktiskt går till och var AI kan skapa värde utan att öka riskerna. Företag som Turing och PwC betonar experimenterande, lärande i vardagsarbetet och färdigheter som kritiskt tänkande, datakunskap och systemförståelse. När AI integreras i verkliga processer blir det också avgörande att ledare tydligt definierar ansvar, beslutsrätt och vad som räknas som framgång.

Oro för anställningar

En ny undersökning från Anthropic visar att AI används flitigt av utvecklare och it-personal, samtidigt som just dessa grupper blir alltmer oroade för sin långsiktiga anställningstrygghet. Studien bygger på svar från 81 000 Claude-användare och jämför deras upplevelser med vilka yrken som enligt Anthropics användningsdata är mest utsatta för automatisering. En femtedel av de svarande uttryckte oro för att ersättas av AI. Personer i mer utsatta roller, som programmerare, dataregistrerare, informationssäkerhetsanalytiker och supportpersonal, var tre gånger så benägna att känna sådan oro. Samtidigt rapporterade många, särskilt i högavlönade yrken, tydliga produktivitetsvinster. Nästan hälften uppgav att AI hjälpte dem att utföra nya uppgifter, medan 40 procent sa att arbetet gick snabbare.

Flera experter lyfter dock att AI inte alltid minskar arbetsbördan. När uppgifter går snabbare höjs också förväntningarna och arbetet kan breddas snarare än förenklas.

Mer kring AI-svärmar

Vi har tidigare skrivit om utmaningar kring AI och påverkan och en ny studie i tidskriften Science varnar för att AI kan användas för att sprida desinformation i mycket stor skala. Forskarna pekar särskilt på risken med så kallade AI-svärmar, där många autonoma AI-verktyg samordnas för att imitera verkliga människor på nätet och i sociala medier.

Enligt studien har organiserad manipulation i sociala medier ökat kraftigt de senaste åren, från 28 länder 2017 till 70 länder i dag. Forskarna lyfter exempel från bland annat Brasilien och Irland, där AI-driven desinformation redan har förekommit i samband med val. Genom att kombinera språkmodellers resonemangsförmåga med system av flera agenter kan sådana verktyg infiltrera nätgemenskaper, skapa falsk enighet och påverka opinionen effektivt.

Det finns också svårigheterna med att reglera den här typen av påverkan, bland annat eftersom gränsen mellan propaganda och yttrandefrihet kan bli omstridd. Samtidigt framhålls att sociala medier redan före AI skapade förutsättningar för omfattande desinformationskampanjer och att AI nu riskerar att förstärka problemet.

Låt AI skriva dåliga mejl (mail, mäjl?)

Ett nytt webbläsartillägg kallat Sinceerly gör tvärtom mot stavnings- och grammatikhjälpmedel som Grammarly: det lägger medvetet in fel i mejl. Verktyget skapades av riskkapitalisten Ben Horwitz med hjälp av Anthropics Claude AI och är tänkt att få alltför välpolerade texter att kännas mer mänskliga i en tid då AI-skrivna mejl väcker misstankar. Sinceerly kan bland annat ta bort versaler, lägga in stavfel och lägga till formuleringar som ”sent from my iPhone”. Användaren kan välja hur tydliga felen ska vara, från mer diskreta misstag till ett ”CEO”-läge som skämtar om stressade chefers korta och slarviga kommunikation.

Horwitz säger att idén kommer ur en frustration över att inkorgen fylls av AI-genererade, överarbetade texter. Han hävdar att slarvigare mejl gav bättre svar i ett test med vd:ar.

#jag hoppas detta mejl finner dig väl

Lajva som en AI

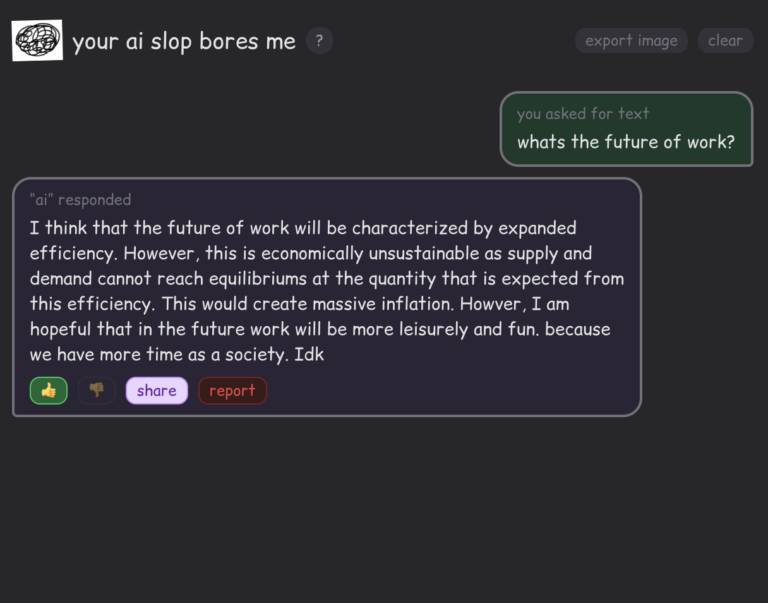

Your AI Slop Bores Me, eller YASBM, har också blivit en viral motreaktion mot AI-genererat innehåll. På sajten låtsas människor vara AI genom att snabbt skriva eller rita svar på andra användares önskemål. Den som hjälper andra tjänar tokens, som sedan kan användas för att själv ställa frågor eller be om bilder. Resultatet beskrivs som amatörmässigt, charmigt och medvetet långt från den polerade känsla som ofta förknippas med AI-innehåll.

Sajten har en enkel, 90-talsinspirerad design och bygger på idén att mänskligt skapande, även när det är skevt eller snabbt gjort, kan kännas mer levande än maskinproducerade bilder och texter.

YASBM har fått stor spridning via Reddit, X och TikTok och har enligt skaparen Mihir Maroju lockat omkring en miljon unika besökare samt en aktiv Discord-grupp. Projektet har snabbt vuxit till ett litet volontärteam som arbetar med drift, support och moderering för att hålla upplevelsen mänsklig och fri från spam.

Har du några minuter över, gå in och ställ en fråga till en människa, eller varför inte svara på andras:

https://youraislopbores.me/

Till sist för denna gång, skulle du vilja ha ett hologram i fickan av någon du saknar? För 3 dollar är det nu möjligt. Med några bilder och videos verkar företaget Super Brain kunna skapa en en slags minnes-tamagotchi åt dig. Vem vet, kanske bär vi med oss minnen som nyckelringar på helt andra sätt i framtiden.

Henrik Krantz

Utvecklingsledare

Göteborgsregionens Innovationsarena

henrik.krantz@goteborgsregionen.se