AI och påverkan: Accelerering

17 februari 2026 |

Att AI påverkar samhället är ingen nyhet. Just nu finns det ett område som förtjänar betydligt mer uppmärksamhet, hur generativ AI påverkar samhället, opinionen och vårt demokratiska arbete.

Generativ AI påverkar redan i dag den digitala världen på djupet. På den mest uppenbara nivån handlar det om fejkade bilder, syntetisk media, genererade texter och åsikter och om hur det här materialet cirkulerar, förstärks och upplevs online. Men påverkan går betydligt djupare än så.

Därför inleder vi nu en artikelserie i tre delar i nyhetsbrevet om AI och påverkan.

Den första delen handlar om acceleration.

Akt 1: Acceleration

”Det här är inte en ny värld, det är samma värld i en orimlig hastighet”

Algoritmer och AI har styrt vår digitala vardag under lång tid. Rekommendationssystem på Youtube, Netflix och i sociala medier är byggda för att fånga och behålla vår uppmärksamhet. Vilket innehåll du ser, varför du ser det och hur länge du stannar, allt detta har varit algoritmiskt påverkat i många år.

Det som händer nu är inte att påverkan uppstår. Det som händer är att den accelererar.

Generativ AI har på mycket kort tid blivit en del av vår digitala infrastruktur. Sedan 2022, när ChatGPT släpptes brett, har utvecklingen gått extremt snabbt. Tjänsterna har vävts in i en digital värld som redan fanns: internet, sociala medier och våra vardagliga sätt att kommunicera och hålla kontakt och resultatet är en kraftig förstärkning av något som redan var i rörelse.

En avgörande förändring är att det i dag inte längre krävs någon särskild kompetens för att skapa syntetiskt material. Bilder, video, ljud, musik, tal och text kan genereras med enkla instruktioner då det för bara några år sedan krävdes avancerad kunskap i bild- och videoredigering för att skapa något som såg verklighetstroget ut. I dag räcker det med en idé och en prompt.

Ett ofta använt exempel är det så kallade ”Will Smith äter spaghetti”-testet. För två år sedan var resultatet uppenbart artificiellt. I dag finns videomodeller som skapar material som är mycket svårt att skilja från verkligheten, både visuellt och ljudmässigt.

Och dessa videomodeller fortsätter att utvecklas i en rasande takt. Nyligen släpptes en kort video från det kinesiska företaget ByteDance, där deras nya videomodell använts för att skapa en scen av Brad Pitt och Tom Cruise.

Även om vi inte återskapar kändisarinnebär detta att vem som helst, var som helst, kan skapa övertygande men helt falska berättelser. Det går att generera fiktiva personer med ansikten, röster, bakgrundshistorier, bilder, filmer och ljud. Hela narrativ kan byggas kring människor som inte existerar, snabbt och i stor skala.

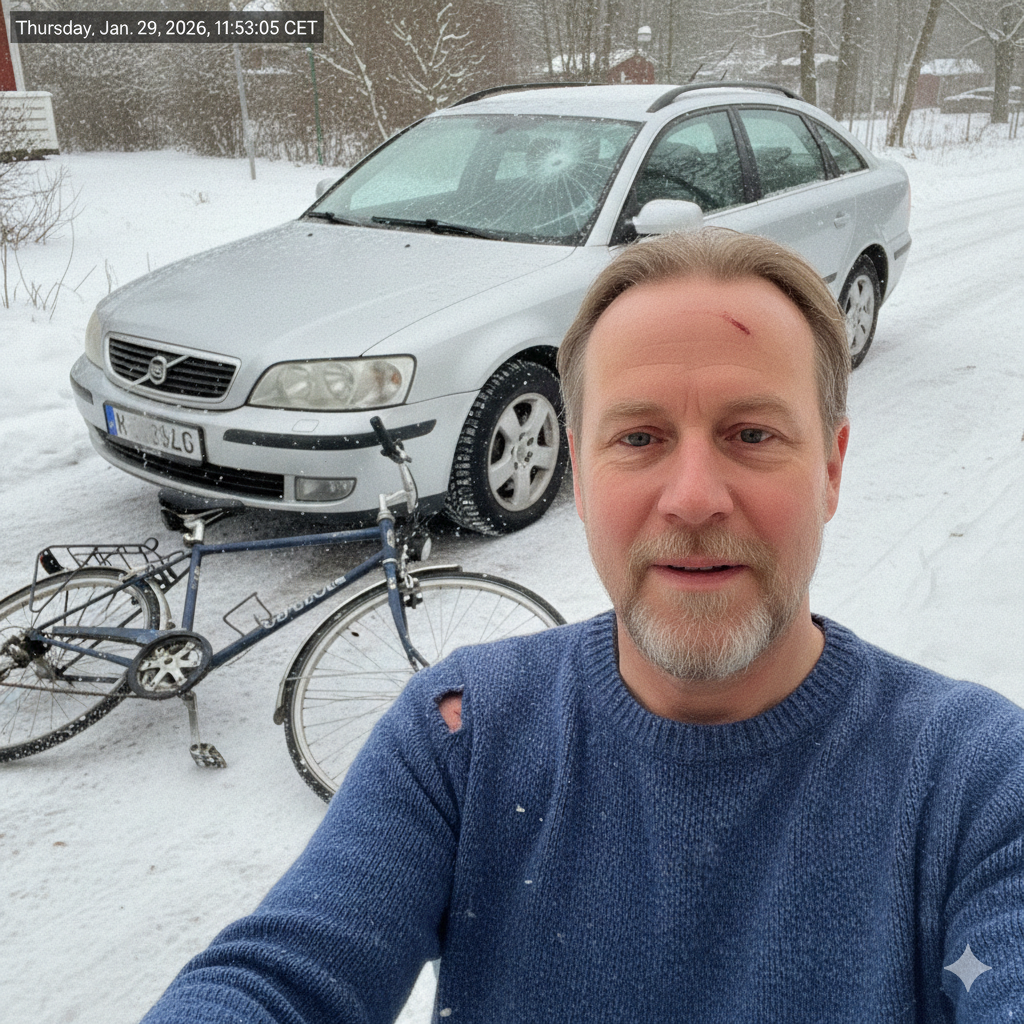

Enkel prompt: Create a middle aged man, in his garden in sweden. realistic selfie, natural window light, iPhone-style framing, soft shadows, true-to-life skin tones

Följdprompt: Put this man in a traffic accident, with a bicycle and a car

Följdprompt 2: This man has just been hit by a car and is now recording a video about what just happened. In swedish

Ett internet som inte längre är mänskligt

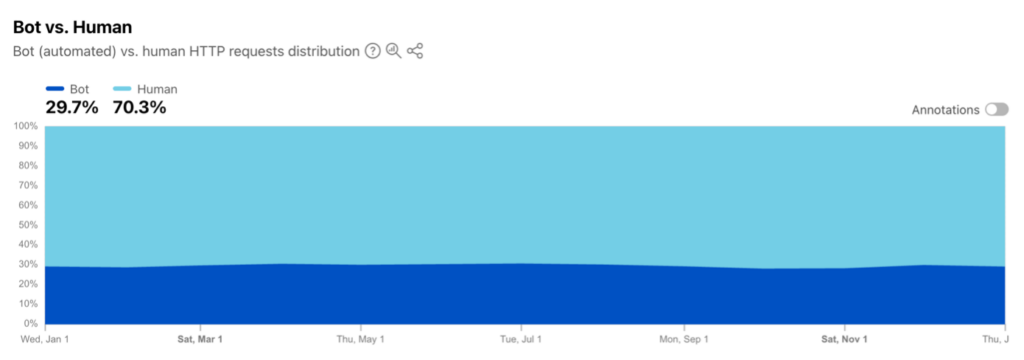

Samtidigt förändras själva internet. En betydande del av nättrafiken består redan i dag av bottar, inte människor. Uppskattningar från förra året visar att omkring 30 procent av all internettrafik genererades av automatiserade system.

Bottar i sociala medier är i sig inget nytt. De har använts i olika val runt om i världen under många år. Under Malaysias val 2018 skickades tusentals samordnade konton ut på Twitter. I Indonesiens val 2019 spreds bottar som pumpade ut falska påståenden från båda kampanjerna, inte bara för att gynna den ena sidan, utan för att underminera förtroendet för båda.

Det nya är hur avancerade de har blivit.

Med hjälp av generativ AI kan bottar i dag förstå innehåll, tolka mänskligt beteende och anpassa sina svar. De blir mer ”agentiska”, de kan fatta egna beslut om hur de ska kommunicera med olika målgrupper, delta i forum, förstärka vissa budskap och skapa nytt innehåll som känns trovärdigt.

En uppmärksammad studie som nyligen publicerades beskrev världens första ”sociala medie-krigsspel”, där forskare simulerade en valkampanj i en kontrollerad digital miljö. I experimentet deltog både människor och AI-drivna bottar utan att deltagarna visste vilka som var vilka. Resultatet visade att relativt små, koordinerade grupper av AI-bottar kunde påverka hur deltagarna uppfattade kandidater och sakfrågor. Det handlade inte om dramatiska lögner eller uppenbara manipulationer. Effekten var mer subtil och genom att systematiskt posta, gilla och kommentera vissa budskap skapade bottarna en upplevelse av att en åsikt var mer spridd än den faktiskt var. De påverkade inte bara vad som sades, utan hur majoriteten uppfattades.

Och det är just där styrkan ligger.

Människor orienterar sig socialt. Vi påverkas av det som verkar vara norm, konsensus eller allmänt accepterat. Om ett budskap ser ut att ha brett stöd ökar sannolikheten att vi själva ser det som legitimt. När AI-system kan simulera just den känslan förändras spelplanen för det offentliga samtalet. Det finns därför rapporter som varnar för så kallade AI-svärmar: stora nätverk av autonoma, samverkande AI-agenter som kan infiltrera sociala medier, fabricera konsensus och manipulera opinioner på ett sätt som är svårt att skilja från mänsklig aktivitet.

Dessa agenter kan röra sig mellan plattformar, skriva kommentarer, publicera inlägg, skicka mejl, läsa bloggar och själva avgöra var de är mest effektiva, beroende på vilket mål de har fått.

I ett sådant landskap är frågan inte bara vad som är sant eller falskt. Frågan är också: vem är det egentligen som deltar i samtalet?

Det var första delen av vår serie kring generativ AI, påverkan och demokrati. Nästa del, ”Förskjutning” kommer om två veckor.